从视频中估计人体姿势在各种应用中起着至关重要的作用,例如量化体育锻炼、手语识别和全身手势控制。例如,它可以构成瑜伽、舞蹈和健身应用的基础。它还可以在增强现实中将数字内容和信息叠加在物理世界之上。

MediaPipe Pose 是一种用于高保真身体姿势跟踪的 ML 解决方案,利用我们的 BlazePose 研究从 RGB 视频帧推断整个身体上的 33 个 3D 地标和背景分割掩码,该研究也为 ML Kit 姿势检测 API 提供支持。当前最先进的方法主要依赖于强大的桌面环境进行推理,而我们的方法在大多数现代手机、台式机/ 笔记本 电脑、python 甚至网络上实现了实时性能。

该解决方案利用两步检测器-跟踪器 ML 管道,经证明在我们的 MediaPipe Hands 和 MediaPipe Face Mesh 解决方案中有效。使用检测器,管道首先在帧内定位人/姿势感兴趣区域 (ROI)。跟踪器随后裁剪帧ROI作为输入来预测 ROI 内的姿势标志和分割掩码。请注意,对于视频用例,仅在需要时调用检测器,即在第一帧以及当跟踪器无法再识别前一帧中存在的身体姿势时。对于其他帧,管道只是从前一帧的姿势地标中导出 ROI。

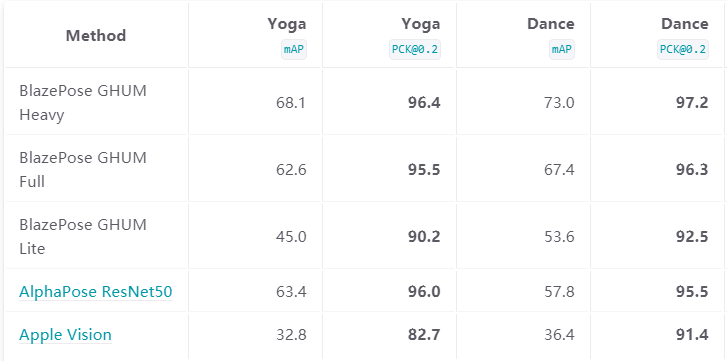

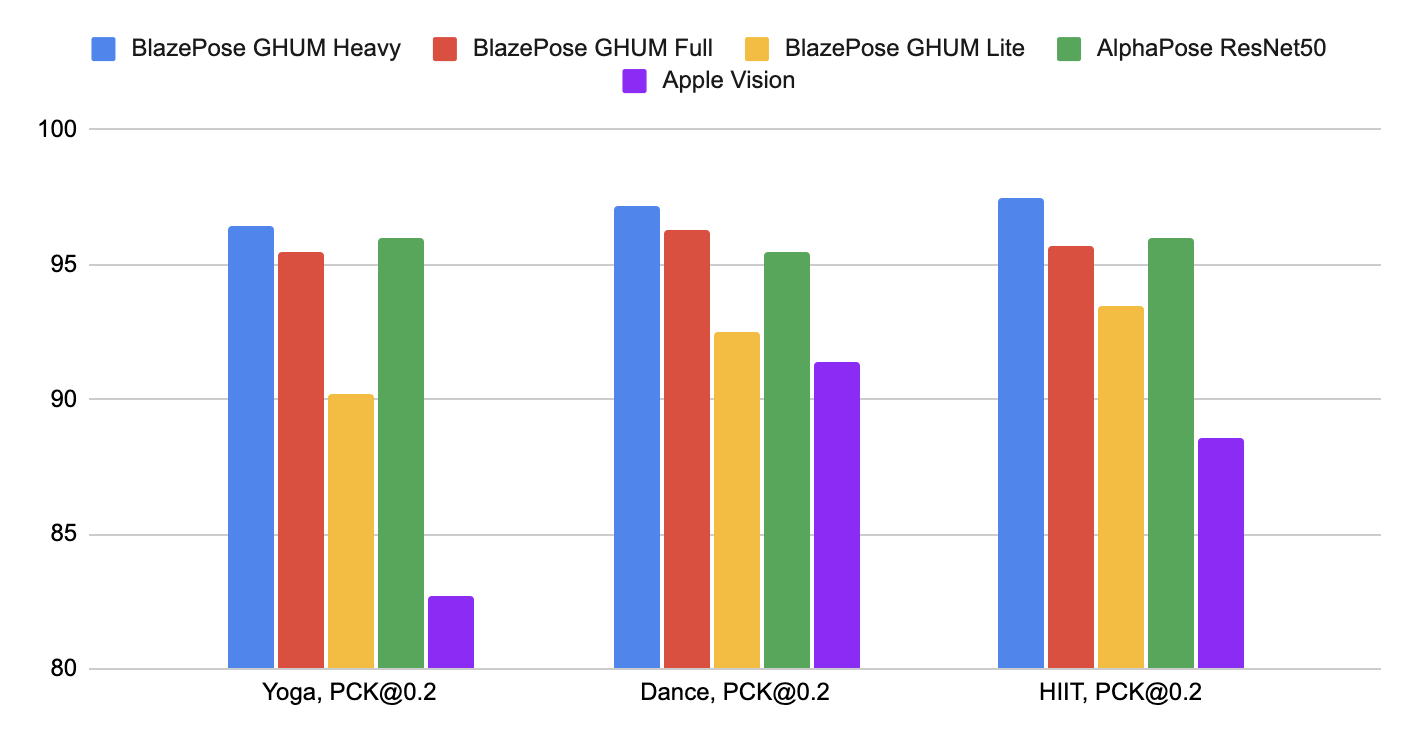

为了根据其他性能良好的公开可用解决方案评估我们的模型的质量,我们使用了三个不同的验证 数据集 ,代表不同的垂直领域:瑜伽、舞蹈。每张图像仅包含距离摄像机 2-4 米的一个人。为了与其他解决方案保持一致,我们仅对 COCO 拓扑中的 17 个关键点进行评估。

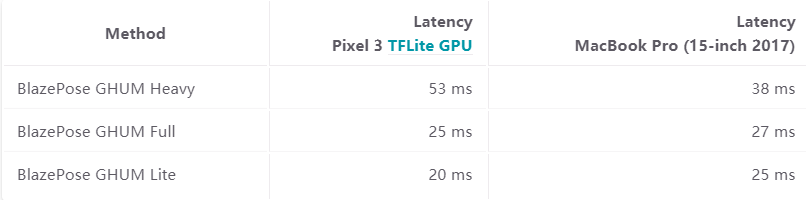

我们专门为实时感知用例设计了我们的模型,所以它们都能在大多数现代设备上实时工作。

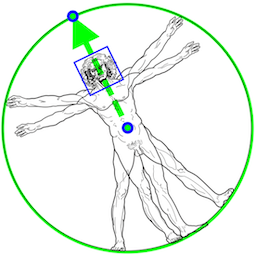

该检测器的灵感来自我们自己的轻量级 BlazeFace 模型,在 MediaPipe 人脸检测 中用作人员检测器的代理。它明确地预测了两个额外的虚拟关键点,这些虚拟关键点将人体中心、旋转和比例牢牢地描述为一个圆圈。受列奥纳多的维特鲁威人的启发,我们预测了一个人臀部的中点、外接整个人的圆的半径以及连接肩部和臀部中点的线的倾斜角。

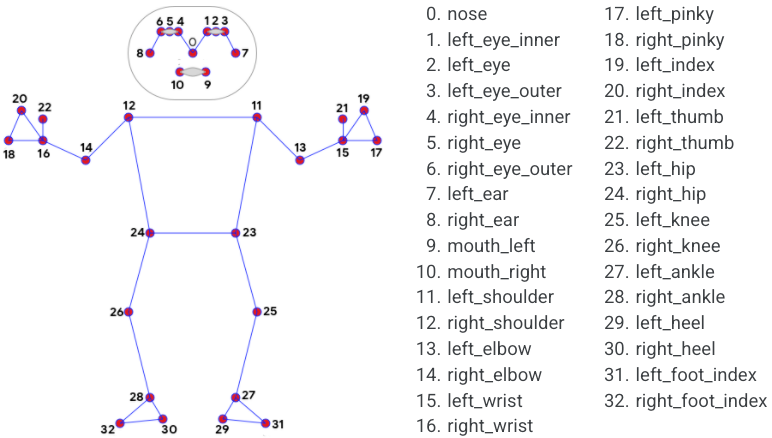

MediaPipe Pose中的地标模型预测了33个地标的位置(见下图)。

可选的是,MediaPipe Pose可以预测表示为两类分割(人或背景)的全身分割掩膜。

STATIC_IMAGE_MODE:如果设置为 false,该解决方案会将输入图像视为视频流。它将尝试在第一张图像中检测最突出的人,并在成功检测后进一步定位姿势地标。在随后的图像中,它只是简单地跟踪那些地标,而不会调用另一个检测,直到它失去跟踪,以减少计算和延迟。如果设置为 true,则人员检测会运行每个输入图像,非常适合处理一批静态的、可能不相关的图像。默认为false。MODEL_COMPLEXITY:姿势地标模型的复杂度:0、1 或 2。地标准确度和推理延迟通常随着模型复杂度的增加而增加。默认为 1。SMOOTH_LANDMARKS:如果设置为true,解决方案过滤不同的输入图像上的姿势地标以减少抖动,但如果static_image_mode也设置为true则忽略。默认为true。UPPER_BODY_ONLY:是要追踪33个地标的全部姿势地标还是只有25个上半身的姿势地标。ENABLE_SEGMENTATION:如果设置为 true,除了姿势地标之外,该解决方案还会生成分割掩码。默认为false。SMOOTH_SEGMENTATION:如果设置为true,解决方案过滤不同的输入图像上的分割掩码以减少抖动,但如果 enable_segmentation设置为false或者static_image_mode设置为true则忽略。默认为true。MIN_DETECTION_CONFIDENCE:来自人员检测模型的最小置信值 ([0.0, 1.0]),用于将检测视为成功。默认为 0.5。MIN_TRACKING_CONFIDENCE:来自地标跟踪模型的最小置信值 ([0.0, 1.0]),用于将被视为成功跟踪的姿势地标,否则将在下一个输入图像上自动调用人物检测。将其设置为更高的值可以提高解决方案的稳健性,但代价是更高的延迟。如果 static_image_mode 为 true,则忽略,人员检测在每个图像上运行。默认为 0.5。具有“pose_landmarks”字段的 NamedTuple 对象,其中包含检测到的最突出人物的姿势标志。

支持配置选项:

import cv2

import mediapipe as mp

import time

mpDraw = mp.solutions.drawing_utils

mpPose = mp.solutions.pose

pose = mpPose.Pose()

cap = cv2.VideoCapture('sample_video.mp4')

pTime = 0

while True:

success, img = cap.read()

imgRGB = cv2.cvtColor(img, cv2.COLOR_BGR2RGB)

results = pose.process(imgRGB)

# print(results.pose_landmarks)

if results.pose_landmarks:

mpDraw.draw_landmarks(img, results.pose_landmarks, mpPose.POSE_CONNECTIONS)

for id, lm in enumerate(results.pose_landmarks.landmark):

h, w, c = img.shape

print(id, lm)

cx, cy = int(lm.x * w), int(lm.

免责声明:本文系网络转载或改编,未找到原创作者,版权归原作者所有。如涉及版权,请联系删