使用tensorflow过程中,训练结束后我们需要用到模型文件。有时候,我们可能也需要用到别人训练好的模型,并在这个基础上再次训练。这时候我们需要掌握如何操作这些模型数据。

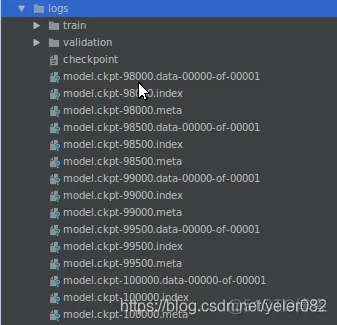

我们在checkpoint_dir目录下保存的文件结构如下:

|--checkpoint_dir

| |--checkpoint

| |--MyModel.meta

| |--MyModel.data-00000-of-00001

| |--MyModel.index

MyModel.meta文件保存的是图结构,meta文件是pb(protocol buffer)格式文件,包含变量、op、集合等。

ckpt文件是二进制文件,保存了所有的weights、biases、gradients等变量。在tensorflow 0.11之前,保存在.ckpt文件中。0.11后,通过两个文件保存,如:

MyModel.data-00000-of-00001

MyModel.index

我们还可以看,checkpoint_dir目录下还有checkpoint文件,该文件是个文本文件,里面记录了保存的最新的checkpoint文件以及其它checkpoint文件列表。在inference时,可以通过修改这个文件,指定使用哪个model

tensorflow 提供了tf.train.Saver类来保存模型,值得注意的是,在tensorflow中,变量是存在于Session环境中,也就是说,只有在Session环境下才会存有变量值,因此,保存模型时需要传入session:

saver = tf.train.Saver()

saver.save(sess,"./checkpoint_dir/MyModel")

看一个简单例子:

import tensorflow as tf

w1 = tf.Variable(tf.random_normal(shape=[2]), name='w1')

w2 = tf.Variable(tf.random_normal(shape=[5]), name='w2')

saver = tf.train.Saver()

with tf.Session() as sess:

sess.run(tf.global_variables_initializer())

saver.save(sess, './checkpoint_dir/MyModel')

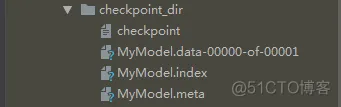

执行后,在checkpoint_dir目录下创建模型文件如下:

另外,如果想要在1000次迭代后,再保存模型,只需设置global_step参数即可:

saver.save(sess, './checkpoint_dir/MyModel',global_step=1000)

保存的模型文件名称会在后面加-1000,如下:

checkpoint

MyModel-1000.data-00000-of-00001

MyModel-1000.index

MyModel-1000.meta

在实际训练中,我们可能会在每1000次迭代中保存一次模型数据,但是由于图是不变的,没必要每次都去保存,可以通过如下方式指定不保存图:

saver.save(sess, './checkpoint_dir/MyModel',global_step=step,write_meta_graph=False)

另一种比较实用的是,如果你希望每2小时保存一次模型,并且只保存最近的5个模型文件(tensorflow默认只会保存最近的5个模型文件,如果你希望保存更多,可以通过max_to_keep来指定,可以指定0或者None表示所有的都保存下来,但是这样的话如果模型很大就会很占据存储空间):

如果我们不对tf.train.Saver指定任何参数,默认会保存所有变量。如果你不想保存所有变量,而只保存一部分变量,可以通过指定variables/collections。在创建tf.train.Saver实例时,通过将需要保存的变量构造list或者dictionary,传入到Saver中:

首先我们定义三个变量,用来模拟需要保存的模型参数:

import tensorflow as tf

# 在tensorflow中变量都有trainable参数,默认为True

w1 = tf.Variable(tf.random_normal(shape=[2,3]), name='w1',trainable=False) #将w1设置为不参与训练更新

w2 = tf.Variable(tf.random_normal(shape=[3,2]), name='w2')

w3 = tf.Variable(tf.random_normal(shape=[3,4]), name='w3')

# c = tf.matmul()

saver = tf.train.Saver([w1,w2])

with tf.Session() as sess:

sess.run(tf.global_variables_initializer())

saver.save(sess, './checkpoint_dir/MyModel',global_step=1000)

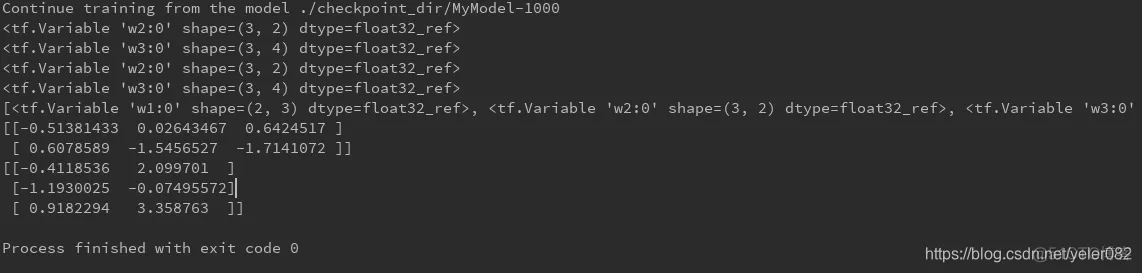

接下来读取该模型,并将模型参数恢复,恢复完成以后查看其中恢复的数据:

主要包括两个要点:

1 tf.train.import_meta_graph()构造网络图

2 restore()加载参数

import tensorflow as tf

# 开始加载模型

ckpt = tf.train.get_checkpoint_state('./checkpoint_dir/')

with tf.Session() as sess:

if ckpt and ckpt.model_checkpoint_path:

print("Continue training from the model {}".format(ckpt.model_checkpoint_path))

restore_saver = tf.train.import_meta_graph('./checkpoint_dir/MyModel-1000.meta')

# latest_checkpoint()中的参数只需要指定checkpoint文件所在的文件夹

restore_saver.restore(sess, ckpt.model_checkpoint_path)

# trainable_variables()参数可指定scope作用域,即打印作用域中的参数

for var in tf.trainable_variables():

print(var)

# 打印全局参数

print(tf.global_variables())

print(sess.run("w1:0"))

print(sess.run("w2:0"))

# 打印w3:0的值会报错: Attempting to use uninitialized value w3

# 这样可以知道,前面tf.train.Saver()在保存的时候,变量名称其实都是保存了的,但是其中w3的值并没有保存下来

# print(sess.run("w3:0"))

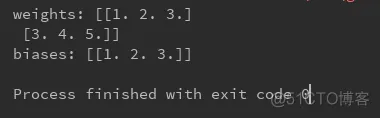

1 还是先保存一个模型

import tensorflow as tf

import numpy as np

W = tf.Variable([[1, 2, 3], [3, 4, 5]], dtype=tf.float32, name='weights')

b = tf.Variable([[1, 2, 3]], dtype=tf.float32, name='biases')

saver = tf.train.Saver()

with tf.Session() as sess:

sess.run(tf.global_variables_initializer())

save_path = saver.save(sess, "checkpoint_dir/save_net.ckpt")

2 恢复模型

import tensorflow as tf

import numpy as np

# 至少需要定义一个需要恢复的变量,否则报错 ValueError: No variables to save

# 这里的W 和b 不在需要指定值,但是要确保 维度、数据类型和名称一致

W = tf.Variable(np.arange(6).reshape((2, 3)), dtype=tf.float32, name="weights")

b = tf.Variable(np.arange(3).reshape((1, 3)), dtype=tf.float32, name="biases")

saver = tf.train.Saver()

with tf.Session() as sess:

saver.restore(sess, "./checkpoint_dir/save_net.ckpt")

print("weights:", sess.run(W))

print("biases:", sess.run(b))

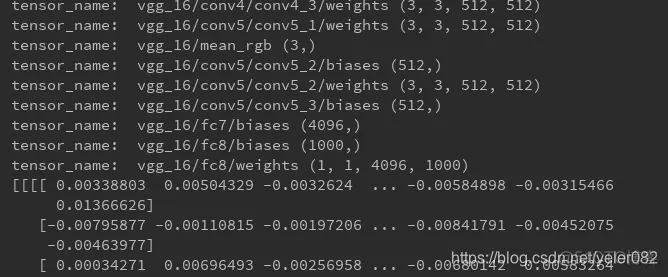

假如现在我只有一个模型文件,如vgg_16.ckpt模型文件,该模型文件是在tensorflow提供的model zoo中下载下来的。我们想在没有计算图的情形下查看里面包含哪些变量,变量的维度,以及变量的值,可以使用下面的代码:

import tensorflow as tf

import os

from tensorflow.python import pywrap_tensorflow

model_dir ="./vgg_16_2016_08_28"

checkpoint_path = os.path.join(model_dir,"vgg_16.ckpt")

reader = pywrap_tensorflow.NewCheckpointReader(checkpoint_path)

var_to_shape_map = reader.get_variable_to_shape_map()

# 输出权重tensor名字和值

for key in var_to_shape_map:

# 分别打印张量名称,对应的shape

print("tensor_name: ", key,reader.get_tensor(key).shape)

# 打印对应名称下的张量的值

print(reader.get_tensor("vgg_16/fc8/weights"))

前面我们理解了如何保存和恢复模型,很多时候,我们希望使用一些已经训练好的模型,如prediction、fine-tuning以及进一步训练等。这时候,我们可能需要获取训练好的模型中的一些中间结果值,可以通过graph.get_tensor_by_name('w1:0')来获取,注意w1:0是tensor的name。

假设我们有一个简单的网络模型,代码如下:

import tensorflow as tf

w1 = tf.placeholder("float", name="w1")

w2 = tf.placeholder("float", name="w2")

b1= tf.Variable(2.0,name="bias")

#定义一个op,用于后面恢复

w3 = tf.add(w1,w2)

w4 = tf.multiply(w3,b1,name="op_to_restore")

with tf.Session() as sess:

sess.run(tf.global_variables_initializer())

#创建一个Saver对象,用于保存所有变量

saver = tf.train.Saver()

#通过传入数据,执行op

print(sess.run(w4,feed_dict ={w1:4,w2:8}))

#打印 24.0 ==>(w1+w2)*b1

#现在保存模型

saver.save(sess, './checkpoint_dir/MyModel',global_step=1000)

接下来我们使用graph.get_tensor_by_name()方法来操纵这个保存的模型。

import tensorflow as tf

with tf.Session() as sess:

#先加载图和参数变量

saver = tf.train.import_meta_graph('./checkpoint_dir/MyModel-1000.meta')

saver.restore(sess, tf.train.latest_checkpoint('./checkpoint_dir'))

# 这个打印只输出了bias:0,这意味着placeholder是不保存的

for var in tf.trainable_variables():

print(var)

# 访问placeholders变量,并且创建feed-dict来作为placeholders的新值

graph = tf.get_default_graph()

w1 = graph.get_tensor_by_name("w1:0")

w2 = graph.get_tensor_by_name("w2:0")

# 向placeholders变量插入新的值

feed_dict ={w1:13.0,w2:17.0}

#接下来,访问你想要执行的op

op_to_restore = graph.get_tensor_by_name("op_to_restore:0")

print(sess.run(op_to_restore,feed_dict))

#打印结果为60.0==>(13+17)*2

注意:保存模型时,只会保存变量的值,placeholder里面的值不会被保存

如果你不仅仅是用训练好的模型,还要加入一些op,或者说加入一些layers并训练新的模型,可以通过一个简单例子来看如何操作:

import tensorflow as tf

with tf.Session() as sess:

# 先加载图和变量

saver = tf.train.import_meta_graph('./checkpoint_dir/MyModel-1000.meta')

saver.restore(sess, tf.train.latest_checkpoint('./checkpoint_dir'))

# 访问placeholders变量,并且创建feed-dict来作为placeholders的新值

graph = tf.get_default_graph()

w1 = graph.get_tensor_by_name("w1:0")

w2 = graph.get_tensor_by_name("w2:0")

feed_dict = {w1: 13.0, w2: 17.0}

#接下来,访问你想要执行的op

op_to_restore = graph.get_tensor_by_name("op_to_restore:0")

# 在当前图中能够加入op

add_on_op = tf.multiply(op_to_restore, 2)

print (sess.run(add_on_op, feed_dict))

# 打印120.0==>(13+17)*2*2

如果只想恢复图的一部分,并且再加入其它的op用于fine-tuning。只需通过graph.get_tensor_by_name()方法获取需要的op,并且在此基础上建立图,看一个简单例子,假设我们需要在训练好的VGG网络使用图,并且修改最后一层,将输出改为2,用于fine-tuning新数据:

......

......

saver = tf.train.import_meta_graph('vgg16.meta')

# 访问图

graph = tf.get_default_graph()

#访问用于fine-tuning的output

fc7= graph.get_tensor_by_name('fc7:0')

#如果你想修改最后一层梯度,需要如下

fc7 = tf.stop_gradient(fc7) # It's an identity function

fc7_shape= fc7.get_shape().as_list()

num_outputs=10

weights = tf.Variable(tf.truncated_normal([fc7_shape[3], num_outputs], stddev=0.05))

biases = tf.Variable(tf.constant(0.05, shape=[num_outputs]))

output = tf.matmul(fc7, weights) + biases

pred = tf.nn.softmax(output)

# Now, you run this with fine-tuning data in sess.run()

免责声明:本文系网络转载或改编,未找到原创作者,版权归原作者所有。如涉及版权,请联系删

武汉格发信息技术有限公司,格发许可优化管理系统可以帮你评估贵公司软件许可的真实需求,再低成本合规性管理软件许可,帮助贵司提高软件投资回报率,为软件采购、使用提供科学决策依据。支持的软件有: CAD,CAE,PDM,PLM,Catia,Ugnx, AutoCAD, Pro/E, Solidworks 等。