1) Tensorflow的模型(model)长什么样子?

2) 如何保存tensorflow的模型?

3) 如何恢复一个tensorflow模型来用于预测或者迁移学习?

4) 如何使用预训练好的模型(imported pretrained models)来用于fine-tuning和 modification

5) 如何同时加载多个模型?

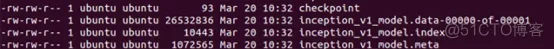

当你已经训练好一个神经网络之后,你想要保存它,用于以后的使用,部署到产品里面去。所以,Tensorflow模型是什么?Tensorflow模型主要包含网络的设计或者图(graph),和我们已经训练好的网络参数的值。因此Tensorflow模型有两个主要的文件:

A) Meta graph:

这是一个保存完整Tensorflow graph的protocol buffer,比如说,所有的 variables, operations, collections等等。这个文件的后缀是 .meta 。

B) Checkpoint file:

这是一个包含所有权重(weights),偏置(biases),梯度(gradients)和所有其他保存的变量(variables)的二进制文件。它包含两个文件:

mymodel.data-00000-of-00001

mymodel.index

其中,.data文件包含了我们的训练变量。

另外,除了这两个文件,Tensorflow有一个叫做checkpoint的文件,记录着已经最新的保存的模型文件。

注:Tensorflow 0.11版本以前,Checkpoint file只有一个后缀名为.ckpt的文件。

因此,总结来说,Tensorflow(版本0.10以后)模型长这个样子:

Tensorflow版本0.11以前,只包含以下三个文件:

inception_v1.meta

inception_v1.ckpt

checkpoint

接下来说明如何保存模型。

当网络训练结束时,我们要保存所有变量和网络结构体到文件中。在Tensorflow中,我们可以创建一个tf.train.Saver() 类的实例,如下:

saver = tf.train.Saver()

由于Tensorflow变量仅仅只在session中存在,因此需要调用save方法来将模型保存在一个session中。

saver.save(sess, 'my-test-model')

在这里,sess是一个session对象,其中my-test-model是你给模型起的名字。下面是一个完整的例子:

import tensorflow as tf

w1 = tf.Variable(tf.random_normal(shape=[2]), name='w1')

w2 = tf.Variable(tf.random_normal(shape=[5]), name='w2')

saver = tf.train.Saver()

sess = tf.Session()

sess.run(tf.global_variables_initializer())

saver.save(sess, 'my_test_model')

模型文件如下:

# This will save following files in Tensorflow v >= 0.11

# my_test_model.data-00000-of-00001

# my_test_model.index

# my_test_model.meta

# checkpoint

如果我们想在训练1000次迭代之后保存模型,可以使用如下方法保存

saver.save(sess, 'my_test_model',global_step=1000)

这个将会在模型名字的后面追加上‘-1000’,下面的文件将会被创建:

my_test_model-1000.index

my_test_model-1000.meta

my_test_model-1000.data-00000-of-00001

checkpoint

由于网络的图(graph)在训练的时候是不会改变的,因此,我们没有必要每次都重复保存.meta文件,可以使用如下方法:

saver.save(sess, 'my-model',global_step=step,write_meta_graph=False)

如果你只想要保存最新的4个模型,并且想要在训练的时候每2个小时保存一个模型,那么你可以使用max_to_keep 和 keep_checkpoint_every_n_hours,如下所示:

#saves a model every 2 hours and maximum 4 latest models are saved.

saver = tf.train.Saver(max_to_keep=4, keep_checkpoint_every_n_hours=2)

注意到,我们在tf.train.Saver()中并没有指定任何东西,因此它将保存所有变量。如果我们不想保存所有的变量,只想保存其中一些变量,我们可以在创建tf.train.Saver实例的时候,给它传递一个我们想要保存的变量的list或者字典。示例如下:

import tensorflow as tf

w1 = tf.Variable(tf.random_normal(shape=[2]), name='w1')

w2 = tf.Variable(tf.random_normal(shape=[5]), name='w2')

saver = tf.train.Saver([w1,w2])

sess = tf.Session()

sess.run(tf.global_variables_initializer())

saver.save(sess, 'my_test_model',global_step=1000)

如果你想要使用别人已经训练好的模型来fine-tuning,那么你需要做两个步骤:

A)创建网络Create the network:

你可以通过写python代码,来手动地创建每一个、每一层,使得跟原始网络一样。

但是,如果你仔细想的话,我们已经将模型保存在了 .meta 文件中,因此我们可以使用tf.train.import()函数来重新创建网络,使用方法如下:

saver = tf.train.import_meta_graph('my_test_model-1000.meta')

注意,这仅仅是将已经定义的网络导入到当前的graph中,但是我们还是需要加载网络的参数值。

B)加载参数Load the parameters

我们可以通过调用restore函数来恢复网络的参数,如下:

with tf.Session() as sess:

new_saver = tf.train.import_meta_graph('my_test_model-1000.meta')

new_saver.restore(sess, tf.train.latest_checkpoint('./'))

在这之后,像w1和w2的tensor的值已经被恢复,并且可以获取到:

with tf.Session() as sess:

saver = tf.train.import_meta_graph('my-model-1000.meta')

saver.restore(sess,tf.train.latest_checkpoint('./'))

print(sess.run('w1:0'))

##Model has been restored. Above statement will print the saved value of w1.

上面介绍了如何保存和恢复一个Tensorflow模型。下面介绍一个加载任何预训练模型的实用方法。

下面介绍如何恢复任何一个预训练好的模型,并使用它来预测,fine-tuning或者进一步训练。当你使用Tensorflow时,你会定义一个图(graph),其中,你会给这个图喂(feed)训练数据和一些超参数(比如说learning rate,global step等)。下面我们使用placeholder建立一个小的网络,然后保存该网络。注意到,当网络被保存时,placeholder的值并不会被保存。

import tensorflow as tf

#Prepare to feed input, i.e. feed_dict and placeholders

w1 = tf.placeholder("float", name="w1")

w2 = tf.placeholder("float", name="w2")

b1= tf.Variable(2.0,name="bias")

feed_dict ={w1:4,w2:8}

#Define a test operation that we will restore

w3 = tf.add(w1,w2)

w4 = tf.multiply(w3,b1,name="op_to_restore")

sess = tf.Session()

sess.run(tf.global_variables_initializer())

#Create a saver object which will save all the variables

saver = tf.train.Saver()

#Run the operation by feeding input

print sess.run(w4,feed_dict)

#Prints 24 which is sum of (w1+w2)*b1

#Now, save the graph

saver.save(sess, 'my_test_model',global_step=1000)

现在,我们想要恢复这个网络,我们不仅需要恢复图(graph)和权重,而且也需要准备一个新的feed_dict,将新的训练数据喂给网络。我们可以通过使用graph.get_tensor_by_name()方法来获得已经保存的操作(operations)和placeholder variables。

#How to access saved variable/Tensor/placeholders

w1 = graph.get_tensor_by_name("w1:0")

## How to access saved operation

op_to_restore = graph.get_tensor_by_name("op_to_restore:0")

如果我们仅仅想要用不同的数据运行这个网络,可以简单的使用feed_dict来将新的数据传递给网络。

import tensorflow as tf

sess=tf.Session()

#First let's load meta graph and restore weights

saver = tf.train.import_meta_graph('my_test_model-1000.meta')

saver.restore(sess,tf.train.latest_checkpoint('./'))

# Now, let's access and create placeholders variables and

# create feed-dict to feed new data

graph = tf.get_default_graph()

w1 = graph.get_tensor_by_name("w1:0")

w2 = graph.get_tensor_by_name("w2:0")

feed_dict ={w1:13.0,w2:17.0}

#Now, access the op that you want to run.

op_to_restore = graph.get_tensor_by_name("op_to_restore:0")

print sess.run(op_to_restore,feed_dict)

#This will print 60 which is calculated

#using new values of w1 and w2 and saved value of b1.

如果你想要给graph增加更多的操作(operations)然后训练它,可以像如下那么做:

import tensorflow as tf

sess=tf.Session()

#First let's load meta graph and restore weights

saver = tf.train.import_meta_graph('my_test_model-1000.meta')

saver.restore(sess,tf.train.latest_checkpoint('./'))

# Now, let's access and create placeholders variables and create feed-dict to feed new data

graph = tf.get_default_graph()

w1 = graph.get_tensor_by_name("w1:0")

w2 = graph.get_tensor_by_name("w2:0")

feed_dict ={w1:13.0,w2:17.0}

#Now, access the op that you want to run.

op_to_restore = graph.get_tensor_by_name("op_to_restore:0")

#Add more to the current graph

add_on_op = tf.multiply(op_to_restore,2)

print sess.run(add_on_op,feed_dict)

#This will print 120.

但是,你可以只恢复旧的graph的一部分,然后插入一些操作用于fine-tuning?当然可以。仅仅需要通过 by graph.get_tensor_by_name() 方法来获取合适的operation,然后在这上面建立graph。下面是一个实际的例子,我们使用meta graph 加载了一个预训练好的vgg模型,并且在最后一层将输出个数改成2,然后用新的数据fine-tuning。

......

......

saver = tf.train.import_meta_graph('vgg.meta')

# Access the graph

graph = tf.get_default_graph()

## Prepare the feed_dict for feeding data for fine-tuning

#Access the appropriate output for fine-tuning

fc7= graph.get_tensor_by_name('fc7:0')

#use this if you only want to change gradients of the last layer

fc7 = tf.stop_gradient(fc7) # It's an identity function

fc7_shape= fc7.get_shape().as_list()

new_outputs=2

weights = tf.Variable(tf.truncated_normal([fc7_shape[3], num_outputs], stddev=0.05))

biases = tf.Variable(tf.constant(0.05, shape=[num_outputs]))

output = tf.matmul(fc7, weights) + biases

pred = tf.nn.softmax(output)

# Now, you run this with fine-tuning data in sess.run()

另外一个例子:

import tensorflow as tf

import numpy as np

x = tf.placeholder(tf.float32, shape=[None, 1])

y = 4 * x + 4

w = tf.Variable(tf.random_normal([1], -1, 1))

b = tf.Variable(tf.zeros([1]))

y_predict = w * x + b

loss = tf.reduce_mean(tf.square(y - y_predict))

optimizer = tf.train.GradientDescentOptimizer(0.5)

train = optimizer.minimize(loss)

isTrain = False

train_steps = 100

checkpoint_steps = 50

checkpoint_dir = ''

saver = tf.train.Saver() # defaults to saving all variables - in this case w and b

x_data = np.reshape(np.random.rand(10).astype(np.float32), (10, 1))

with tf.Session() as sess:

sess.run(tf.initialize_all_variables())

if isTrain:

for i in xrange(train_steps):

sess.run(train, feed_dict={x: x_data})

if (i + 1) % checkpoint_steps == 0:

saver.save(sess, checkpoint_dir + 'model.ckpt', global_step=i+1)

else:

ckpt = tf.train.get_checkpoint_state(checkpoint_dir)

if ckpt and ckpt.model_checkpoint_path:

saver.restore(sess, ckpt.model_checkpoint_path)

else:

pass

print(sess.run(w))

print(sess.run(b))

有时我们希望在一个python的文件空间同时载入多个模型,例如 我们建立了10个CNN模型,然后我们又写了一个预测类Predict,这个类会从已经保存好的模型restore恢复相应的图结构以及模型参数。然后我们会创建10个Predict的对象Instance,每个Instance负责一个模型的预测。

Predict的核心为:

class Predict:

def __init__(self....):

创建sess

创建恢复器tf.train.Saver

从恢复点恢复参数:tf.train.Saver.restore(...)

def predict(self,...):

sess.run(output,feed_dict={输入})

如果我们直接轮流生成10个不同的Predict 对象的话,我们发现tensorflow是会报类似于下面的错误:

File "/home/jiangminghao/.local/lib/python3.5/site-packages/tensorflow/python/framework/errors_impl.py", line 466, in raise_exception_on_not_ok_status

pywrap_tensorflow.TF_GetCode(status))

tensorflow.python.framework.errors_impl.InvalidArgumentError: Assign requires shapes of both tensors to match. lhs shape= [256,512] rhs shape= [640,512]

[[Node: save/Assign_14 = Assign[T=DT_FLOAT, _class=["loc:@fullcont/Variable"], use_locking=true, validate_shape=true, _device="/job:localhost/replica:0/task:0/cpu:0"](fullcont/Variable, save/RestoreV2_14)]]

During handling of the above exception, another exception occurred:

Traceback (most recent call last):

File "PREDICT_WITH_SPARK_DATAFLOW_WA.py", line 121, in <module>

pre2=Predict(label=new_list[1])

File "PREDICT_WITH_SPARK_DATAFLOW_WA.py", line 47, in __init__

self.saver.restore(self.sess,self.ckpt.model_checkpoint_path)

File "/home/jiangminghao/.local/lib/python3.5/site-packages/tensorflow/python/training/saver.py", line 1560, in restore

{self.saver_def.filename_tensor_name: save_path})

File "/home/jiangminghao/.local/lib/python3.5/site-packages/tensorflow/python/client/session.py", line 895, in run

run_metadata_ptr)

File "/home/jiangminghao/.local/lib/python3.5/site-packages/tensorflow/python/client/session.py", line 1124, in _run

feed_dict_tensor, options, run_metadata)

File "/home/jiangminghao/.local/lib/python3.5/site-packages/tensorflow/python/client/session.py", line 1321, in _do_run

options, run_metadata)

File "/home/jiangminghao/.local/lib/python3.5/site-packages/tensorflow/python/client/session.py", line 1340, in _do_call

raise type(e)(node_def, op, message)

tensorflow.python.framework.errors_impl.InvalidArgumentError: Assign requires shapes of both tensors to match. lhs shape= [256,512] rhs shape= [640,512]

关键就是:

**Assign requires shapes of both tensors to match.**意思是载入模型的时候 赋值失败。主要是因为不同对象里面的不同sess使用了同一进程空间下的相同的默认图graph。

正确的解决方法:

class Predict:

def __init__(self....):

self.graph=tf.Graph()#为每个类(实例)单独创建一个graph

with self.graph.as_default():

self.saver=tf.train.import_meta_graph(...)#创建恢复器

#注意!恢复器必须要在新创建的图里面生成,否则会出错。

self.sess=tf.Session(graph=self.graph)#创建新的sess

with self.sess.as_default():

with self.graph.as_default():

self.saver.restore(self.sess,...)#从恢复点恢复参数

def predict(self,...):

sess.run(output,feed_dict={输入})

模型实例

实验场景是会启动多个模型,其中有一个tensorflow模型,有一个Keras的tf模型。tensorflow模型的正常使用即可,而keras模型可以这么用:定义Keras_model.py

if sys.platform=='linux':

os.environ["CUDA_VISIBLE_DEVICES"] = "2,3"

if sys.platform=='linux':

keras_model_file = r"/home/jmh/realtime_traffic_adversarial_attack/src/df/saved_trained_models/DF_epoch50_clusterbursts_dim2300.h5"

else:

keras_model_file = r"E:\TempWorkStation\realtime_traffic_adversarial_attack\src\df\saved_trained_models\DF_epoch50_clusterbursts_dim2300.h5"

class df_model:

def __init__(self):

# 1. define tensorflow Graph and session objector for this model.

self.df_graph = Graph()

self.df_session = Session(graph=self.df_graph)

keras.backend.set_learning_phase(0)

# 2. load model

keras.backend.set_session(self.df_session)

with self.df_session.as_default():

with self.df_graph.as_default():

self.DF_model=keras.models.load_model(keras_model_file)

# 3. prediction now!

def predict(self,x):

with self.df_graph.as_default():

return self.DF_model.predict(x)

#首先创建df_model类的对象

DF_model = df_model()

#预测函数

def predictions(x):

x = np.reshape(x,newshape=(-1,2300,1))

probability = DF_model.predict(x)

#print(probability)

return np.argmax(probability,axis=1)

#预测

# test now!

if __name__ == '__main__':

X_test, y_test=utility.LoadDataNoDef_Single_DataSet('test')

y = predictions(X_test[:10])

print(y)

print(I(X_test[:10],X_test[:10]*1000.0))

在其他脚本from Keras_model import predictions 就可以使用keras训练好模型了。

免责声明:本文系网络转载或改编,未找到原创作者,版权归原作者所有。如涉及版权,请联系删

武汉格发信息技术有限公司,格发许可优化管理系统可以帮你评估贵公司软件许可的真实需求,再低成本合规性管理软件许可,帮助贵司提高软件投资回报率,为软件采购、使用提供科学决策依据。支持的软件有: CAD,CAE,PDM,PLM,Catia,Ugnx, AutoCAD, Pro/E, Solidworks 等。