转载请注明出处:https://blog.csdn.net/qq_39912997

论文链接: Attention-Driven Cropping for Very High Resolution Facial Landmark Detection

作者及团队:苏黎世联邦理工学院

会议及时间:CVPR 2020

摘要

人脸关键点检测是许多消费者和高端应用的基本任务,目前几乎完全由机器学习方法来解决。现有的用于训练这些算法的数据集主要由低分辨率图像组成,而当前的算法仅限于质量和分辨率相当的输入作为训练数据集。另一方面,随着消费者相机质量的逐年提高,高分辨率图像变得越来越普遍。因此,需要能够利用高分辨率图像中丰富信息的算法。由于GPU上的内存瓶颈,在高分辨率图像上重新使用现有的网络架构是不可能的。目前唯一的解决方案是减少图像采样,牺牲分辨率和质量。在基于注意力的网络的最新进展的基础上,我们提出了一种新颖的、完全卷积的区域结构,它是专门为在非常高分辨率的面部图像上预测关键点而设计的,无需下采样。我们通过使用分辨率为256 x 256到4K的图像对建议的模型进行训练,展示了我们架构的灵活性。除了作为第一种在高分辨率图像上进行面部关键点检测的方法外,我们的方法在所有方面都比传统(整体)最先进的架构实现了卓越的性能分辨率,得到一个通用的,非常灵活,高质量关键点检测器。

1.介绍

关键点检测是计算机视觉中的经典机器学习任务之一,如今几乎已完全通过深度神经网络解决。这些基于网络的检测器可提供可靠的检测,但其准确性直接取决于其操作的图像分辨率。尽管如今即使是低端相机也可以捕获高分辨率图像,但由于内存有限,并发GPU只能在低分辨率图像上运行。结果,深度学习算法被迫预测图像上的关键点,其分辨率可能比可用的分辨率低几个数量级,这自然会放大预测的准确性。

当观察人类注释者如何标记图像时,人们可能会意识到它们以多种比例进行标记。在面部关键点的上下文中,它们通常以较低的分辨率注释较粗的特征(例如下颌骨),在这些分辨率下,它们具有面部的完整上下文,但随后放大特定区域(例如眼睛区域)以进行更多注释准确。受此行为的启发,我们提出了一种端到端的注意力驱动的体系结构,该体系结构通过自动定义并关注感兴趣的区域,而不是整体地考虑面部,从而可以在高分辨率图像上训练深度网络。这些区域在低分辨率图像代理上进行标识,并从原始高分辨率图像中提取。然后将它们缩放到适合网络的大小,这样可以使区域与规范作物对齐。然后,第二阶段在此正面放大中定位关键点,这将进一步减少可变性并提高鲁棒性和准确性。

使用我们新颖的注意力驱动架构,我们可以在单个GPU上以高达4K的分辨率预测关键点,这显示出与现有方法相比,强制使用下采样图像的预测精度有了显着提高。我们进一步证明了所提出的概念适用于各种最新的网络架构,从而提高了所有架构的性能。

尽管我们的方法针对的是高分辨率图像,但是在野外应用到传统的低分辨率面部图像时,在大多数情况下,我们的方法也优于当前的最新架构。因此,我们提出的方法是一种通用的人脸界标检测器,在从低分辨率到4K的整个图像尺度上均具有高质量。

2.相关工作

在深度学习出现之前,提出了几种基于级联回归的方法[5,44,41,23],以解决面部关键点检测的问题。这些方法从对关键点的初始猜测开始,并使用机器学习模型的级联对其进行优化。然而,近年来,深度学习方法在面部地标检测方面已显著提高了最先进的水平。为了简明扼要,我们根据这些方法的体系结构及其解决问题的方法来区分和描述这些方法

在网络架构方面,现有工作大致可分为三类,即:i) 包含卷积和全连接或"全连接(dense)"层组合的网络 ii) 全卷积网络,和 iii) 循环网络。前者由以图像为输入的体系结构组成,并学习提取低级和语义特征的卷积滤波器, 然后被展平并传递到一个或多个全连接的层 [53, 8, 25, 56, 20, 3, 21, 27, 51, 50, 45, 32, 37, 12, 28, 13, 52, 55, 29]。另一方面,全卷积的架构 [39,26,30,4,46,47,42,35,38,9,54,36,10] 预测面部关键点的位置作为热图,编码一个关键点出现在特定像素的概率。这些体系结构有几个优点,即 (i) 翻译不变性,(ii) 不同大小的图像可以在训练和测试时间使用,(iii) 它们保证预测的关键点始终位于图像的域内,(iv) 关键点作为热图的表示,使此类网络的预测具有人类可解释性。最后一类是循环网络方法 [40, 1],它旨在通过添加重复层对图像的时间序列进行操作。

基于解决面部关键点检测的方法,上述方法也可以大致分为 i) 基于模型的拟合方法,ii) 多任务学习,以及 iii) 级联或区域模型。基于模型的方法 [56, 20, 3, 21, 27] 假设一个基础低分辨率的 3D 脸模型, 使用学习的特征参数化地适合面部图像。多任务方法[51、50、45、32、52]遵循"辅助学习"原则,共同推断给定面部图像的多个属性,如人的年龄、性别等,以及面部关键点。基于区域的方法 [37, 12, 28, 55] 由一系列体系结构组成,这些体系结构独立分析面部的不同区域。

现有的面部地标探测器在低分辨率图像上效果良好。但是,当高分辨率图像在测试时可用时,由于多种原因,现有算法无法利用存在的额外细节。首先,具有完全连接层的体系结构(包括所有基于区域的方法 [37、12、28])只能与训练它们的大小相同的图像一起使用。这将要求将高分辨率图像向下采样到与体系结构兼容的大小。此外,在向前传递过程中,网络在预测输出之前会生成大型中间特征表示形式,这对高分辨率训练来说可能极具挑战性。实际上,即使分辨率为 512 x 512,也难以在单个 GPU 上安装。

2.1 贡献

在这项工作的基础上,在深度学习的最新进展[17,4,19]的基础上,我们提出对基于区域的面部关键点探测器进行有机演进,并提出一个端到端的可分一步,完全卷积的,基于区域的面部地标探测器。

• 我们将 [17] 引入的注意驱动裁剪与可分的soft-argmax [19] 操作相结合,以实现第一个全卷积区域的面部关键点探测器

• 据我们所知,我们的方法是首次证明在单个 Nvidia 1080Ti GPU 上对分辨率高达 4096 x 4096 的图像进行训练和推断面部关键点的能力。我们展示我们的方法在从 256x256 到 4096x4096 的多个分辨率上的优越性,而不是使用以前最先进的方法检测到的低分辨率关键点的 na +

• 尽管我们的方法专为高分辨率图像而设计,但将非常良好的概括概括为不受约束的自然环境下设置,并且通常优于低分辨率最先进的方法(第 4 节)。

2.2 可用数据集

300-W [33]、300-VW[34]、300-W-LP [56] 是训练面部地标探测器的热门数据集。类似但较近期和较大的数据集包括 [48、49、4]。这些数据集包含 68 个面部关键点的标注。虽然 [33, 48] 是只有 2D 标注的数据集,但 [56、34、4] 包含 2D 和 3D 标注。第 2 节中描述的所有方法都使用一个或多个这些数据集来训练和微调其模型。现有数据集由在无约束设置中捕获的低分辨率影像组成,因为它们旨在用于"在自然环境下"应用程序。相比之下,我们的目标是训练一个关键点探测器,该探测器可以利用高分辨率面部图像中的细节来精确定位关键点。因此,我们不能使用任何现有数据集进行训练。我们创建新的高质量面部关键点数据集,用于训练和测试我们的高分辨率性能(如第 3.3 节所述)。但是,为了显示我们自然环境下影像方法的额外优势,我们还在 300-W [33] 和 300-VW [34] 数据集上进行了实验。

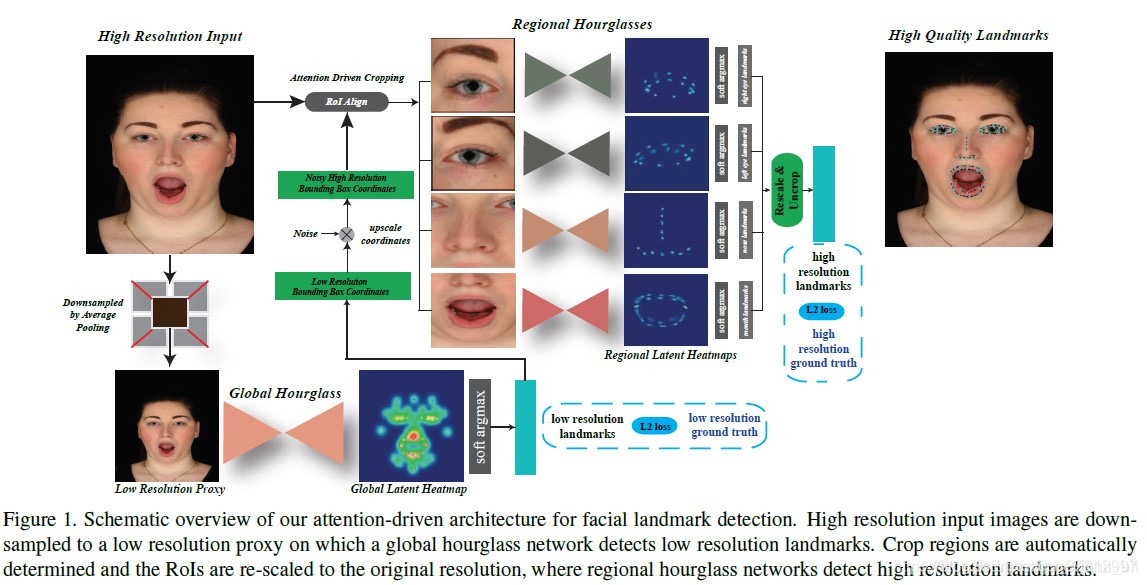

图1。我们用于面部关键点检测的的注意力驱动架构的示意图概述。高分辨率输入图像被向下采样为低分辨率代理,全局沙漏网络可检测到低分辨率关键点。自动确定裁剪区域,将 RoIs 重新缩放到原始分辨率,其中区域沙漏网络可检测高分辨率关键点。

3 方法

在本节中,我们介绍了用于高分辨率面部关键点检测的新架构,如图1所示。受人类如何手动注释高分辨率图像上的地标的启发,我们的模型通过注意力驱动孤立地分析了面部的不同区域裁剪机制。给定初始的高分辨率图像作为输入,全局沙漏网络[30]分析输入图像的相应低分辨率代理,并生成面部关键点的粗略热图。在这些热图中,我们执行不同的softargmax操作以提取关键点坐标的初始估计值。这些低分辨率关键点坐标(coordinates)用于识别与面部的不同结构区域相对应的感兴趣区域(ROI)。对于每个区域,将从原始的高分辨率输入图像中提取高分辨率裁剪,然后通过预测裁剪上关键点的区域特定沙漏网络进行进一步分析。使用来自全局沙漏的ROI信息,将在区域裁剪上预测的关键点恢复到原始图像。由全局和多个区域模型预测的关键点分别受到低分辨率和高分辨率地面实况数据的监督。所提出的体系结构是完全可微的和全卷积的,因此可以端到端地进行训练。

3.1 网络架构

首先通过平均池化将输入的高分辨率图像下采样为256x256像素的固定分辨率。下采样后的图像通过沙漏网络[30](在第4.5节中进行了结构选择)传递,该输出以与低分辨率图像相同的比例输出关键点位置的热图。由于第一个沙漏会预测脸部所有区域的关键点,因此我们将其称为全局沙漏。全局沙漏为每个关键点输出一个热图。诸如[42、30、6、4]等工作从训练数据生成ground truth heatmaps,在测试时使用argmax操作从中提取关键点。这种方法的ground truth heatmaps是通过在地标位置上应用空间高斯滤波器而生成的。手动指定该高斯滤波器σ的标准偏差,并且使用相同的σ来模糊人脸的所有关键点。但是,由于基础特征,训练集中的某些关键点被定位为具有较高的各向异性不确定性。例如,在面部关键点的情况下,比起眼睑,像眼睛和嘴唇的角之类的关键点更容易明确地标识并因此进行标注,其中的关键点在边缘的定位更好,在边缘的不确定性更高。由各向同性的高斯核创建的带有热图的训练网络正在强制执行以下假设:所有关键点的定位都相同(不确定)。与以前的面部关键点检测方法不同,我们选择将卷积网络的输出表示为潜在热图,而无需地面真相监督。这为沙漏网络提供了更大的灵活性,使其比其他关键点更加确定关键点,并使用各向异性的非高斯分布来表示它们。此外,当在初始热图回归上使用softargmax时,我们还观察到了与Iqbal等人[19]报道的准确性类似的提高。全局沙漏输出的潜热图通过通道级空间softmax传递,以确保每个通道都是图像中关键点位置上的概率分布。然后,我们对关键点热图执行soft-argmax [19]操作,以将关键点位置提取为批处理大小x关键点数量x 2矢量。由于soft-argmax操作归结为加权平均值,因此与argmax不同,它是完全可微的。通过这种方式提取关键点位置,使我们能够仅使用ground truth关键点位置来训练全局沙漏,而不必创建ground truth heatmaps,同时确保在网络内部将关键点位置表示为热图,从而保持网络完全卷积。

附加知识:ground truth heatmaps

CornetNet是最经典的Anchor-free方法,本博客主要介绍数据预处理最核心步骤:ground truth heatmaps

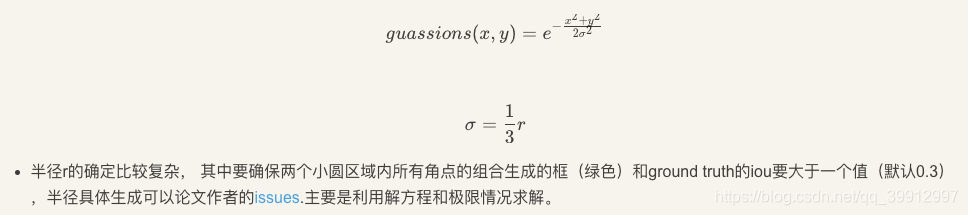

如上图所示,红色框代表ground truth,绿色框的角点在橙色圆圈里面,ground truth heatmap就是通过高斯分布函数生成,以groundtruth的两个角点为中心,利用高斯分布生成heatmap,其中,角点为positive,其余地方为negative。

3.2 Attention-Driven Cropping(注意力驱动的裁剪技术)

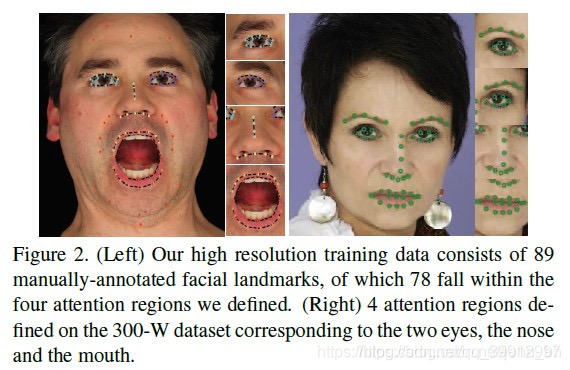

(左)我们的高分辨率训练数据包括89个手动标注的面部标志,其中78个属于我们定义的四个关注区域。

(右)在300-W数据集上定义了四个关注区域,分别对应于两只眼睛,鼻子和嘴巴。

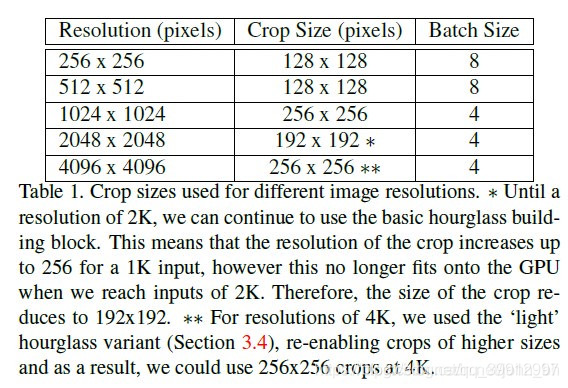

用于不同图像分辨率的裁切尺寸。 ∗在分辨率达到2K之前,我们可以继续使用基本的沙漏构建基块。这意味着对于1K输入,裁剪的分辨率提高到256,但是当我们达到2K输入时,它不再适合GPU。因此,裁剪的大小减小到192x192。 ***对于4K分辨率,我们使用了“轻型”沙漏变体(第3.4节),重新启用了更大尺寸的裁剪,因此,我们可以在4K下使用256x256裁剪。

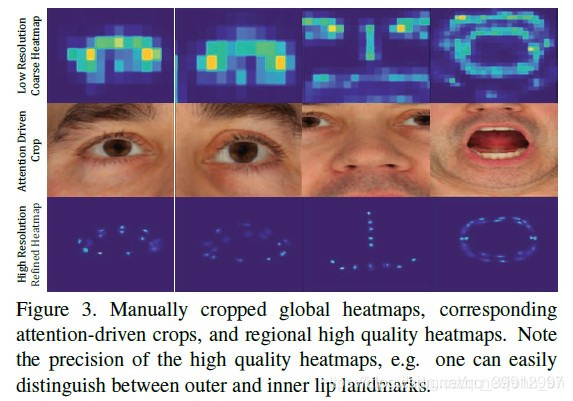

在架构的第二阶段,我们使用来自全局沙漏的关键点估计值来从原始高分辨率图像中提取感兴趣区域(RoI)。然后,由一组特定于区域的沙漏模型分别并行处理这些感兴趣的区域,以定义这些关键点的位置。我们将这些在面部预定区域上运行的沙漏模型称为区域沙漏。在这项工作中,我们训练了四个区域沙漏模型,它们预测左眼,右眼,鼻子和嘴巴区域的界标(请参见图2)。这种方法可以扩展到任意多个ROI,但是由于以下原因,我们将自己限制在这四个区域。在这些区域之外,我们感兴趣的地标包括下巴,脸颊和前额。这些区域通常没有明显的特征,并且由于歧义性,局部分析这些区域实际上可能适得其反。因此,最好由全局沙漏在更大范围内对这些区域进行全局分析。

对于脸部的每个区域,使用softargmax的结果精确计算出一个边界框。与[15、14、17]之类的方法不同,在输入图像仅包含一张脸的情况下,在“自然环境”设置中为每个RoI提案生成多个边界框候选,每个区域生成一个边界框是合理。每个边界框由对应于其左上角和右下角的4个坐标表示。由于这些边界框坐标是从潜热图中提取的,因此可以保证它们位于下采样图像的范围内。来自正态分布的噪声独立地添加到每个边界框的宽度和高度,以使区域模型对于边界框内区域的位置足够健壮。然后将嘈杂的边界框放大,以将其映射到原始高分辨率图像的域。使用[17]引入的RoIAlign操作,我们以可微分的方式从高分辨率图像中提取裁剪。根据图像的原始分辨率,将高分辨率的裁剪调整为固定大小。表1显示了我们用于不同分辨率的区域裁剪的大小。裁剪大小是根据图像的原始分辨率确定的,并在训练过程中保持合理的的批次大小。其他裁剪大小也可以很容易地使用。计算并存储嘈杂的高分辨率边界框和调整大小后的裁剪之间的相对比例因子,以便以后将预测的关键点恢复到其原始分辨率。经过调整大小的裁剪然后传递到相应的区域沙漏。每个区域的沙漏都会预测一个类似于全局沙漏的关键点位置的潜在热图。如前所述,使用softargmax操作从这些区域热图中提取在调整大小的裁剪范围内定义的关键点。使用以前计算出的相应比例因子,将这些区域关键点恢复到图像的原始分辨率。然后,使用嘈杂的边界框坐标取消缩放后的关键点,以获取在高分辨率图像上定义的关键点。

我们的整个架构如图1所示。由于在我们的架构中定义的所有操作都是可区分的,因此可以以端到端的方式一起训练全局沙漏和多个区域沙漏。我们网络的最终输出是一整套用于高分辨率图像的面部关键点位置,这要归功于我们的区域优化模块,其中一部分关键点(眼睛,鼻子和嘴巴)包含了高精度位置。

3.3 训练数据

我们方法的主要贡献之一是,它可以通过注意力驱动的裁剪来训练具有高分辨率图像和避免GPU内存瓶颈的网络。为了验证我们架构的优点,我们需要具有标签关键点的高分辨率人脸数据集。现有的数据集(在第2.2节中进行了描述)包含大量带有2D注释的“自然环境下”设置的图像,但分辨率不够。据我们所知,不存在一个公开可用的高分辨率面部图像和关键点数据集。因此,我们采用[2]的方法在受控的摄影棚环境中拍摄对象。我们从8个执行24种不同面部表情的相机中以4K分辨率捕获了47个对象,并在这些图像上手动注释了89个面部标志。这89个关键点的完整集合如图2所示。在47位受试者中,我们随机抽取24位受试者进行训练,并使用其余23位受试者进行评估。总而言之,我们的训练集总共包含4608张图像,而测试集则包含4416张图像。为了以256 x 256、512 x 512、1024 x 1024、2048 x 2048和4096 x 4096的分辨率进行实验,对训练集和测试集都进行了适当缩放。如图2所示,仅在眼睛,鼻子和嘴巴区域考虑裁剪。在我们的高分辨率数据集中,在89个带标注的关键点中,只有78个落入区域裁剪之内。结果,全局沙漏会预测所有89个关键点,而区域沙漏会预测总共78个关键点。对于300W和300VW,68个关键点中的51个位于我们关注的区域内。因此,在使用300W和300VW进行训练时,我们的全局沙漏将预测68个关键点,而区域沙漏将预测总共51个关键点。

3.4 实现细节

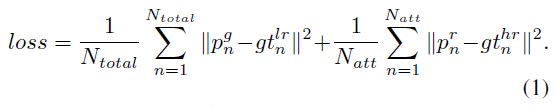

总体 loss 函数是 L 2 l o s s,表达式如下

4 结果与讨论

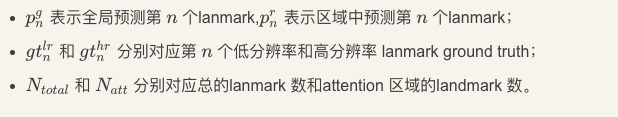

4.1 学习潜在热图

在面部关键点检测中,我们的方法与现有方法不同的一种方式是使用学习到的潜热图表示关键点。在图3中,我们显示了由全局模型和不同区域模型生成的热图的差异。出于可视化的目的,使用最近邻插值对全局模型预测的热图进行了放大,并与区域网络预测的热图一起显示。正如预期的那样,全局热图的质量较低,但可以捕获人脸的整体结构,因此可以实现预期的收成。图3的最后一栏显示了区域模型产生的精确的高分辨率热图。在全局和区域热图中都有强烈激活的位置表明脸上的关键点更加突出。

手动裁剪的全局热图,相应的注意力驱动的裁剪以及区域高质量的热图。请注意高质量热图的精度,例如可以轻松地区分外部和内部嘴唇关键点。

4.2 注意力驱动的裁剪的好处

对局部裁剪进行区域网络训练具有若干优势。首先,它鼓励每个区域网络仅将注意力集中在面部的特定区域上,并因此学习特定于区域的特征,以帮助更准确地预测关键点。图3还显示了如何通过区域网络来细化每个区域的粗略全局热图。正如人们可以凭直觉所期望的那样,在较低的分辨率下难以区分的面部特征开始在区域热图中分离出来,从而实现了精确的定位(图4)。这在嘴巴的情况下尤其明显,在高分辨率区域热图中,外嘴唇和内嘴唇明显分开。

第二个优点是,由于每个区域模型都只看着面部的特定部分,因此区域关键点的质量与其他区域的外观无关。我们希望我们的体系结构的这一特性使整体关键点预测的质量对外观的全局变化更加稳健。

第三,我们的全局局部体系结构旨在仅处理高分辨率输入图像的有意义区域。故意丢弃高分辨率图像的不相关部分可以避免网络变得非常深的需求,也不需要构建无法适应当前GPU的庞大功能表示。仅专注于RoI,就可以通过仅预测有意义的ROI内的关键点,使区域沙漏充分利用所捕获图像中的高频细节。我们的方法使我们能够在不牺牲批量大小的情况下,对高分辨率图像执行深度关键点检测,同时避免不必要的计算。

4.3 在300W和300VW上的评估

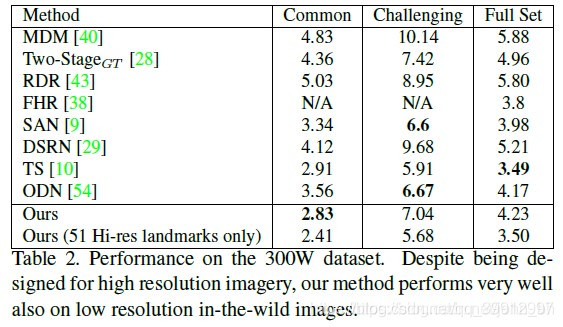

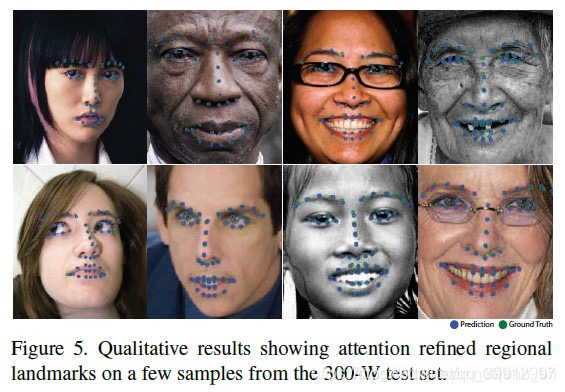

尽管我们的方法主要是为高分辨率图像设计的,但是我们在低分辨率300W和300VW数据集上评估了注意力驱动的裁剪。对于300W,我们将Helen,LFPW,AFW和Ibug数据集拆分为与以前的方法相同的训练和测试集[9,29,38]。我们以256x256像素的分辨率和128x128像素的裁剪大小训练模型,并定义4个感兴趣的区域(2),从中检测到总共51个高分辨率关键点,而下颌线上的其余17个关键点由全局预测滴漏。我们在表2中报告了300W测试装置上的归一化平均误差(NME)[4]指标。即使在256x256像素的情况下,我们的方法也可以在通用子集上建立新的基线,并且与最新技术保持竞争优势在具有挑战性的子集上。图5显示了300W测试装置上的定性关键点预测。此外,正如我们将在4.4节的实验中看到的那样,随着我们转向更高的分辨率,我们注意力驱动的裁剪方法的益处变得越来越大。

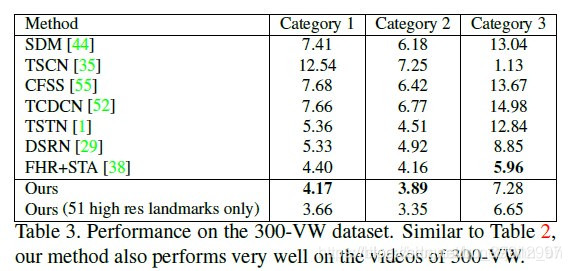

为了在300-VW数据集上验证我们的方法,我们使用50个300-VW的训练视频重新训练了与300W相同的另一个网络。表3将我们的方法与在三个不同测试类别上使用NME指标的现有技术进行了比较。我们的方法再次在3个类别中的2个上产生最佳结果。

300W

300-VW

4.4 在高分辨率上的评估

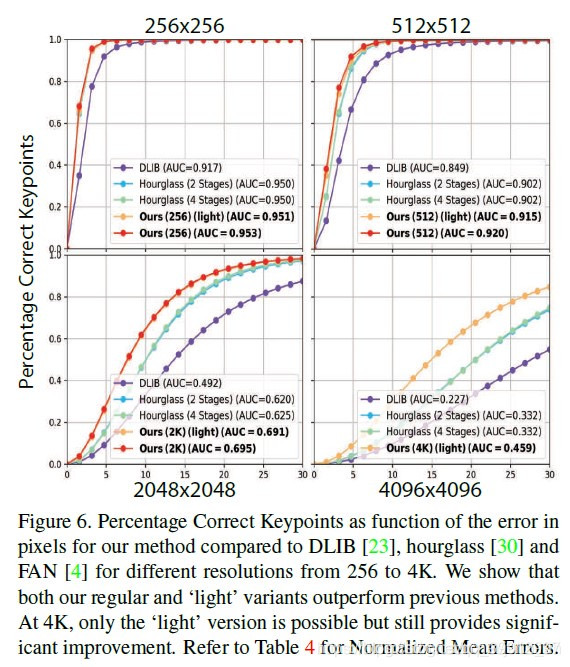

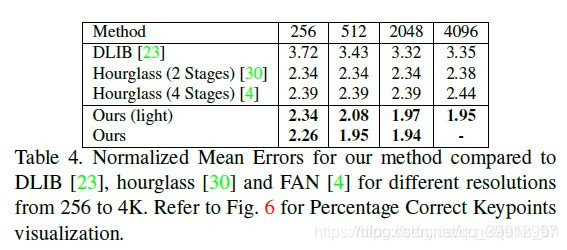

我们将注意力驱动的裁剪体系结构与随机森林算法[23],两级沙漏网络[30]和四级沙漏网络(即称为FAN的2D关键点检测器)进行比较。我们使用第3.3节中描述的低分辨率256数据集来训练随机森林,第2阶段和第4阶段的沙漏网络。

由于我们的体系结构允许以高达4096的分辨率进行训练,因此我们以适当分辨率的数据对其进行了训练。我们使用第3.3节中所述的高质量测试集(包括4416张图像)进行评估。为了进行比较,将随机森林,第2阶段和第4阶段的沙漏所做的预测从256手动放大到评估分辨率。

为了定量比较关键点预测,我们使用[15]所用的正确率百分比(PCK)度量和以前的归一化平均误差(NME)。图6和表4显示了我们的算法与不同方法在256到4096分辨率范围内的定量比较。在4096分辨率下,由于第3.4节中所述的原因,我们仅报告了体系结构的轻型变量的PCK和NME度量。 。在第4.5节中的消融研究中单独考虑了1024的分辨率。

我们的方法(包括灯光变体)在所有分辨率下均优于其他方法,这表明注意驱动的裁剪不仅是使用高分辨率图像进行训练的方法,而且从原理上讲也是一种有效的面部关键点检测方法。随着输入分辨率的提高,我们方法的好处也随之增加。这可以从我们的方法与4级沙漏之间的曲线度线度量下的面积随分辨率提高而得出的差异中得出。

4.5 消融研究

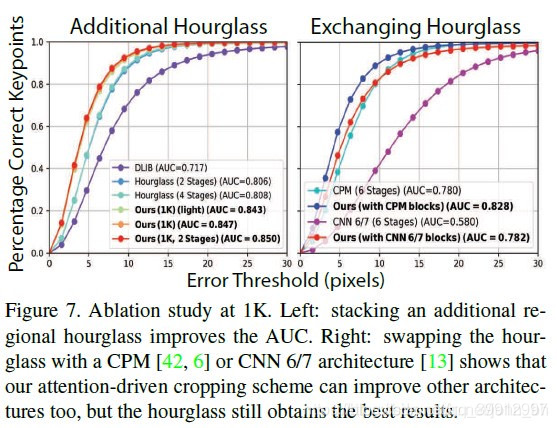

我们以1024的分辨率评估一些架构选择。这些结果如图7所示。

1K消融研究。左:堆叠额外的区域沙漏可改善AUC。正确:将沙漏与CPM [42,6]或CNN 6/7架构[13]进行交换表明,我们的注意力驱动的裁剪方案也可以改善其他架构,但是沙漏仍然获得最佳效果。

附加阶段的影响

在关键点定位中,将模型彼此堆叠是一种常见方法[30、4、42]。通过将多个区域优化模块彼此堆叠,也可以将这种堆叠合并到我们的体系结构中。当我们在图1所示的基础架构中叠加一个额外的区域沙漏时,我们看到了AUC的改进(请参见图7,左)。

架构选择

我们架构的模块化本质使得可以将沙漏与不同的全卷积架构互换。为了验证所提出概念对不同架构选择的鲁棒性,我们考虑了两个最近提出的全卷积架构:i)6级卷积姿态机(CPM)[42,6]和ii)[13]的CNN 6/7架构。 。使用CNN 6/7时,我们将丢弃最后一个完全连接的层以保持网络完全卷积,并追加其他CNN 6/7阶段,其中每个阶段都将上一阶段的图像和热图作为输入。我们重新训练了6阶段CPM和6阶段CNN 6/7架构,并将它们与我们的注意力驱动裁剪概念进行了比较,在该概念中,每个沙漏模块分别被一个单阶段CPM或CNN 6/7取代。在图7的右半部分,我们看到了该实验的结果。尽管我们的注意力驱动的CPM和注意力驱动的CNN 6/7的参数分别小于6阶段CPM和6阶段CNN 6/7架构,但是与注意力驱动的裁剪概念相比,我们发现在切换到关键点检测方面有了很大的改进整体的多阶段方法。这种优越的性能证明了所提出方法的鲁棒性及其对本地化中更普遍问题的适用性。

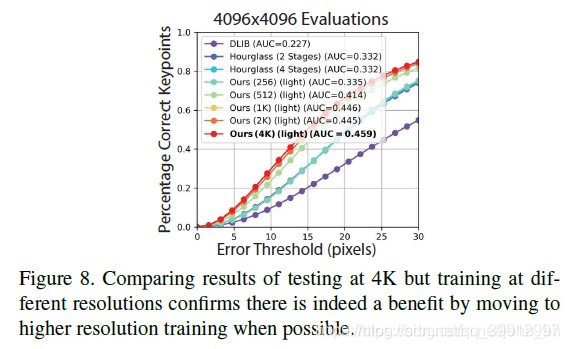

4.5.1 高分辨率检测的必要性

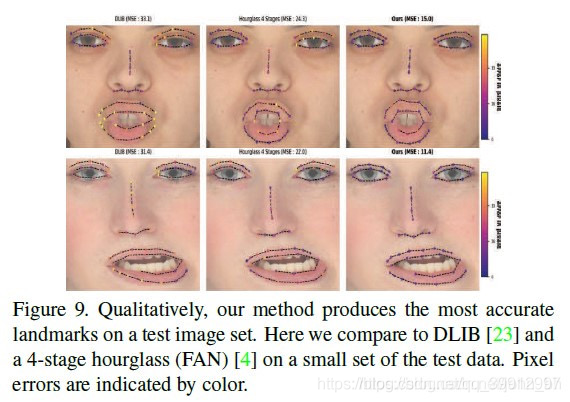

我们捕获的4K图像(第3.3节)由一位人类专家标注。考虑到人类标注关键点的精确度有限[11],因此有必要训练具有超高分辨率图像的模型。在图8中,我们将灯光变体的结果与以4096训练的沙漏构建块进行了比较,并将其与其他以较低分辨率训练的注意力驱动模型的预测结果进行了比较。随着输入数据分辨率的提高,注意力驱动的裁剪框架的性能也随之提高,最终使以4K分辨率直接训练的模型成为性能最佳的模型。由此可见,只要有可能,移至更高的分辨率确实有好处。在图9中,我们在一些不同的测试图像上显示了定性结果。

比较4K的测试结果,但可以在不同分辨率下进行训练,这确实是有好处的,如果可能的话,可以进行更高分辨率的训练。

定性地,我们的方法在测试图像集上产生最准确的关键点。在这里,我们将一小部分测试数据与DLIB [23]和4级沙漏(FAN)[4]进行比较。像素错误由颜色指示。

4.6 局限性

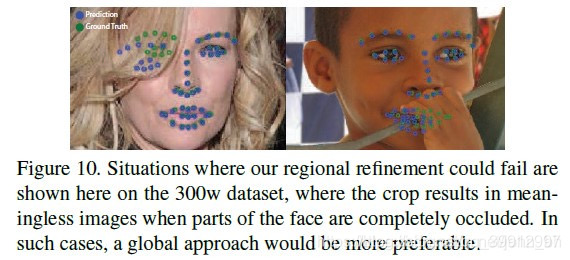

提出的方法旨在通过利用分辨率更高的信息来改进关键点位置信息。如果没有附加信息,或者附加信息像部分遮挡的情况一样是欺骗性的(图 10),则性能会降低。这与经典光圈(aperture)问题有关,未来的工作可以研究确定自动定位特征的最佳分辨率的方法。

5 结论

我们提出了一种新颖、完全卷积的区域架构(architecture),旨在预测高分辨率图像上的关键点。我们的提议是端到端的注意力驱动型架构,它允许通过自动定义和关注感兴趣的区域而不是整体考虑图像来训练高分辨率图像上的深层网络。我们表明,我们的架构在 256 到 4K 的所有分辨率上,都实现了卓越的性能,而不是全式卷积架构。我们相信,我们的方法填补了对算法需求,这些算法可以利用(leverage)高分辨率图像中提供的丰富信息,而高分辨率图像正变得越来越普遍。

免责声明:本文系网络转载或改编,未找到原创作者,版权归原作者所有。如涉及版权,请联系删