学过Python的小伙伴都会觉得,python的语法简单,逻辑清晰。虽然tensorflow是python的一个库(并不是标准库),但是使用并不简单,你可能会被tensorflow的奇怪语法设计困惑,所以本文章叫做费解的tensorflow,希望通过本文,读者可以更好的了解tensorflow。

学习任何编程语言,可能上来都是打印输出下hello world,用python很简单,我们一行代码就可以了。

print('hello world')1.就算是先定义为变量,我们也只是需要2行代码。

a = 'hello world'print(a)1.2.那我们用tensorflow来写,需要3行,代码不是很多,但是看上去就是很费解。

a = tf.constant('hello world')sess = tf.Session()print(sess.run(a))1.2.3.那我们就以这个简单代码,来看看tensorflow的语法。

如果把上面代码抽象出来,其实就是建立计算图和运行计算图的完整过程。当然读者就会问,什么是计算图?其本质就是全局数据结构:是一个有向图,用于捕获有关如何计算的指令。概念还是比较生硬,图那我就以流程图为例,流程中的方框(节点)就是我们tensorflow的定义的数据,箭头就是计算指令。

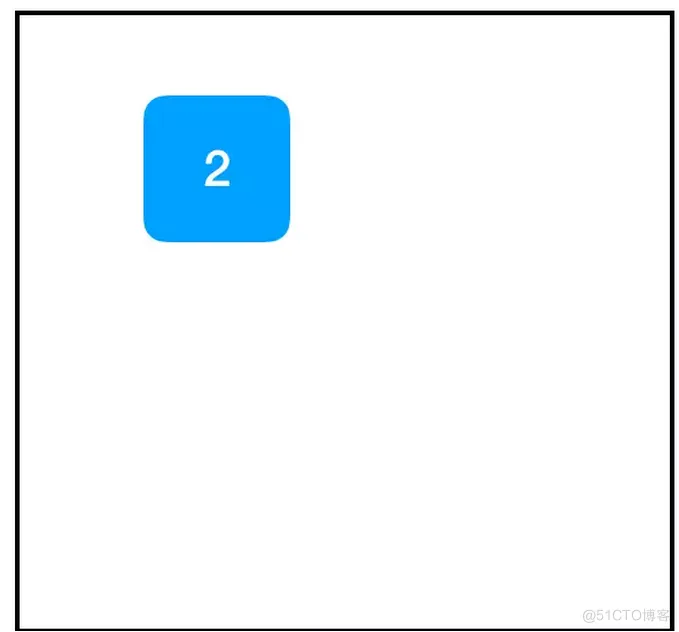

例如,下面代码,我们就定义了一个常量,在计算图中就是给了他一个位置,他就是一个节点。打印输出其说明:

a = tf.constant(2)print(a)# Tensor("Const:0", shape=(), dtype=int32)1.2.3.

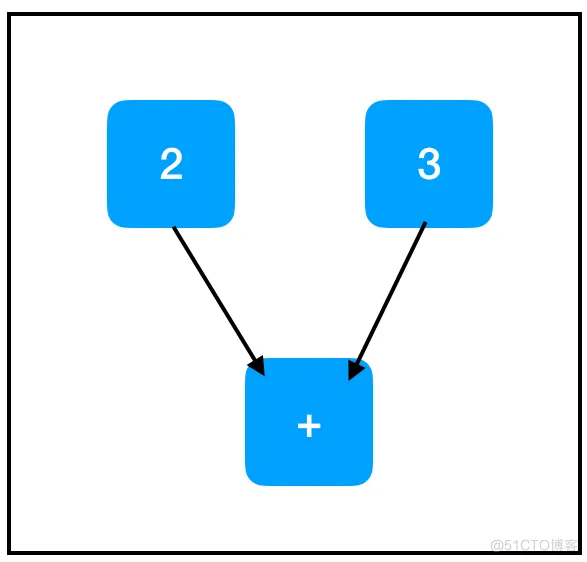

通过下面代码就可以算是完整的计算图(有节点和计算)。

two_node = tf.constant(2)three_node = tf.constant(3)sum_node = two_node + three_node1.2.3.

前面说到了是建立计算图,接着我们就要执行计算图,这样代码才能运行。这里就要提到一个新概念,会话。会话的作用是处理内存分配和优化,使我们能够实际执行由计算图指定的计算。简单说,建立计算图,通过会话,然后运行计算图。

这就是为什么tensorflow代码都有这个代码的原因了。

sess = tf.Session()sess.run()1.2.我们重新在来看下hello world的代码。

a = tf.constant('hello world')sess = tf.Session()print(sess.run(a))# hello world1.2.3.4.前面的程序,我们没有输入,这样就是只会输出同样的东西。在python中,我们可以通过iput输入数据。

在tf中,我们需要先定义占位符,然后用feed_dict方法传入数据,代码如下:

a = tf.placeholder(tf.int32)b = tf.placeholder(tf.int32)c = a + bwith tf.Session() as sess: print(sess.run([a,b,c],feed_dict={a:5,b:8}))# [array(5), array(8), 13]1.2.3.4.5.6.7.前面,我们用tf.constant定义了常量,用占位符(placeholder)用于输入,最后我们看看变量的定义。

说变量之前,我们再来看看tensorflow这个单词,其实他是分为tensor(张量)和flow(流)。变量在tensorflow就是张量的意思。

这里我们定义一个一维张量:

a = tf.Variable([0.2,0.4,0.5])1.接着如果我们建立会话,运行程序会报错。我们需要初始化变量,这里我们不讲解底层的原因,我们只需要记住,用到变量加上下面的代码初始化即可。

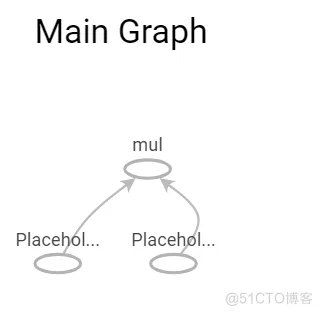

sess = tf.Session()init = tf.global_variables_initializer()sess.run(init)print(sess.run(a))# [0.2 0.4 0.5]1.2.3.4.5.6.最后,我们可视化下我们的计算图。

a = tf.placeholder(tf.int32)b = tf.placeholder(tf.int32)c = a * bwith tf.Session() as sess: print(sess.run([a,b,c],feed_dict={a:5,b:8})) writer = tf.summary.FileWriter('log/test1',sess.graph)writer.close()1.2.3.4.5.6.7.接着我们打开代码所在环境,输入一下代码。

tensorboard --logdir=G:\我的Python项目\深度学习\deeplearn\log\test11.在浏览器中输入http://localhost:6006

本文通过最简单的hello world代码,详细讲解了tf的语法。我们需要记住,整个过程就是建立和运行计算图的流程。

免责声明:本文系网络转载或改编,未找到原创作者,版权归原作者所有。如涉及版权,请联系删

武汉格发信息技术有限公司,格发许可优化管理系统可以帮你评估贵公司软件许可的真实需求,再低成本合规性管理软件许可,帮助贵司提高软件投资回报率,为软件采购、使用提供科学决策依据。支持的软件有: CAD,CAE,PDM,PLM,Catia,Ugnx, AutoCAD, Pro/E, Solidworks 等。