嫌弃GAN生成的图像不够炫酷?

不需要改变数据集,只需要给CLIP下达的命令中把“虚幻引擎”几个字加上,再让CLIP去指挥GAN,图像就立马变成了高大上的CG艺术风。

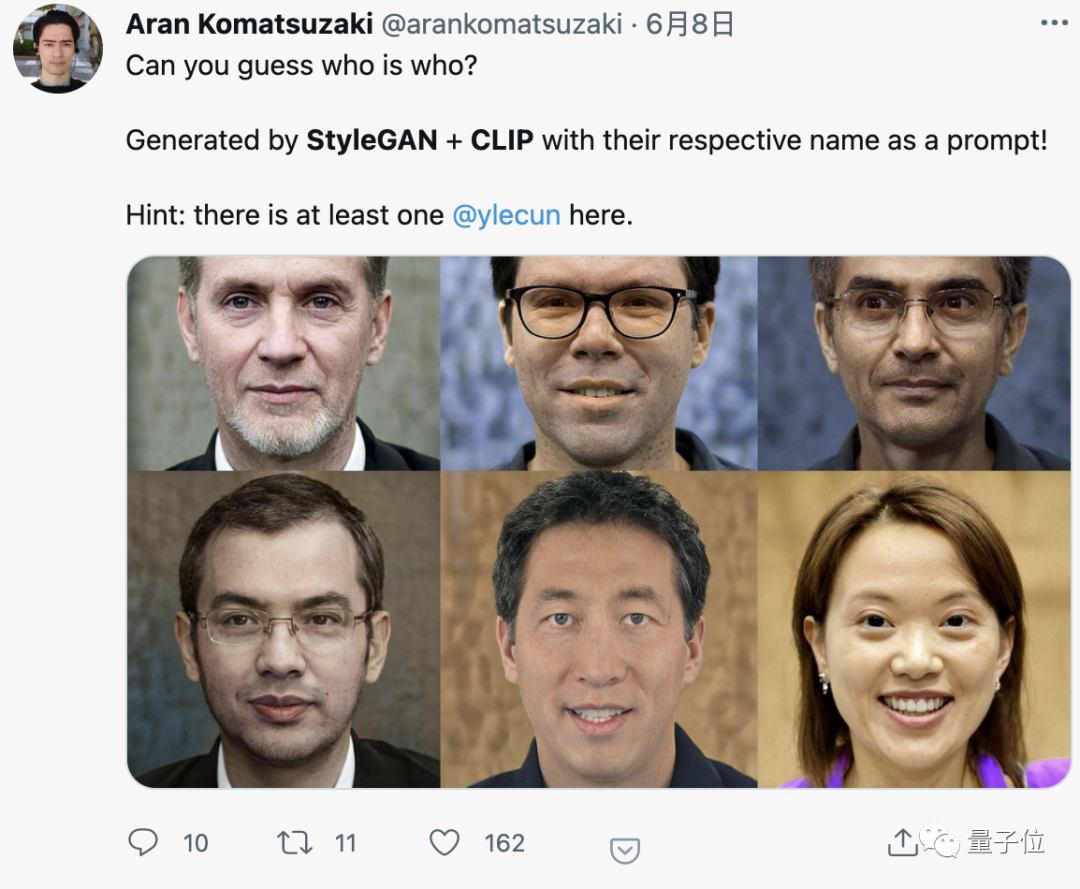

文字中加入虚幻引擎这个技巧,最早由Aran Komatsuzaki发在推特上,吸引了大量CV圈的人来围观。

后来有人把这套流程发在了Colab上,网友们都玩疯了。

还可以指定成“彩色铅笔风格”

或者“吉卜力风格”:

最绝的是,加上“3D photo inpainting”竟然可以生成立体构图。

CLIP是OpenAI开发的一个负责给图像重排序的模型,它与GAN合作的方式也很简单。

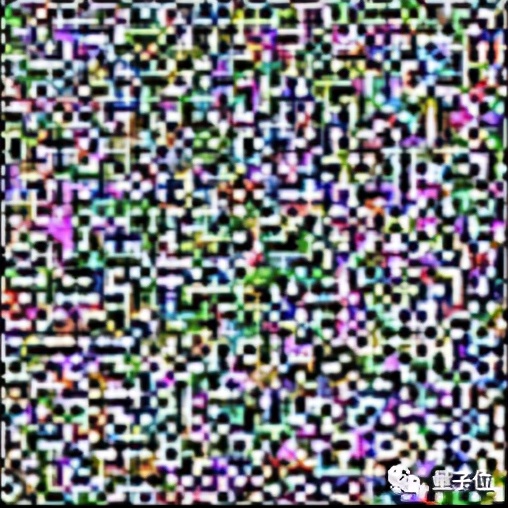

先用一张平平无奇的随机图案作为种子,像这种:

像这样让CLIP算出其与文字描述的相似度打分,然后反馈给GAN,让GAN以提升分数为目标不断迭代。

AI艺术家组合就这么出现了。

除了在提示中加入风格要求之外,还可以直接告诉AI一个人名,看看在AI眼中他们长啥样。

甚至能用来猜猜那些从未露面的大佬们,比如神秘的比特币之父中本聪。

[[407650]]

这就是AI心目中的中本聪,不管你信不信,反正我是信了。

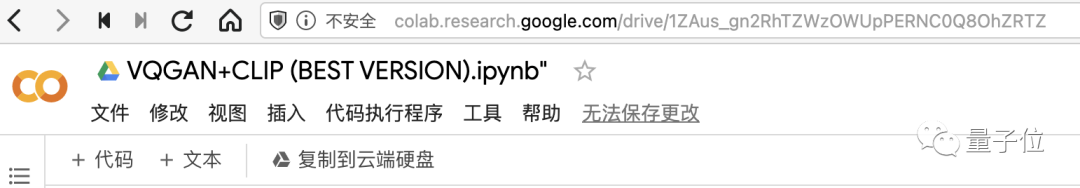

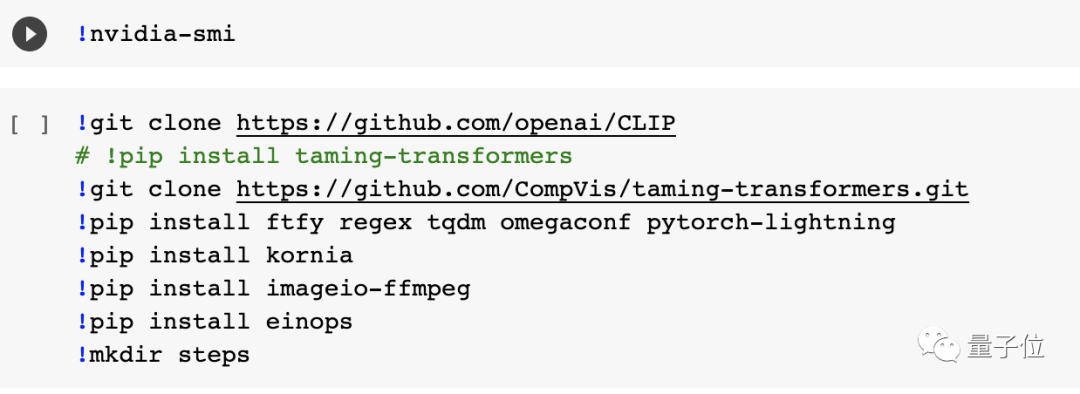

VQGAN+CLIP在Colab上有很多版本,我们经过对比选择了一个加入额外优化和池化技巧,在速度和质量上都比较出色的一个(链接在文章末尾)。

第1步和第2步,按顺序执行就好。

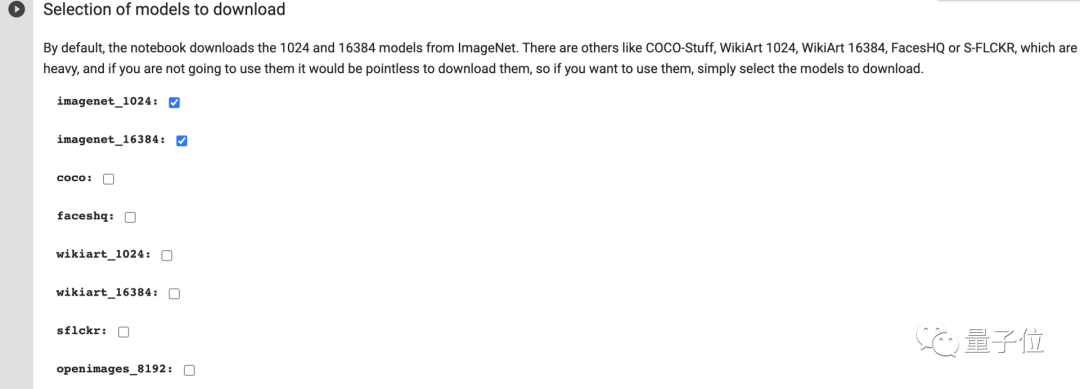

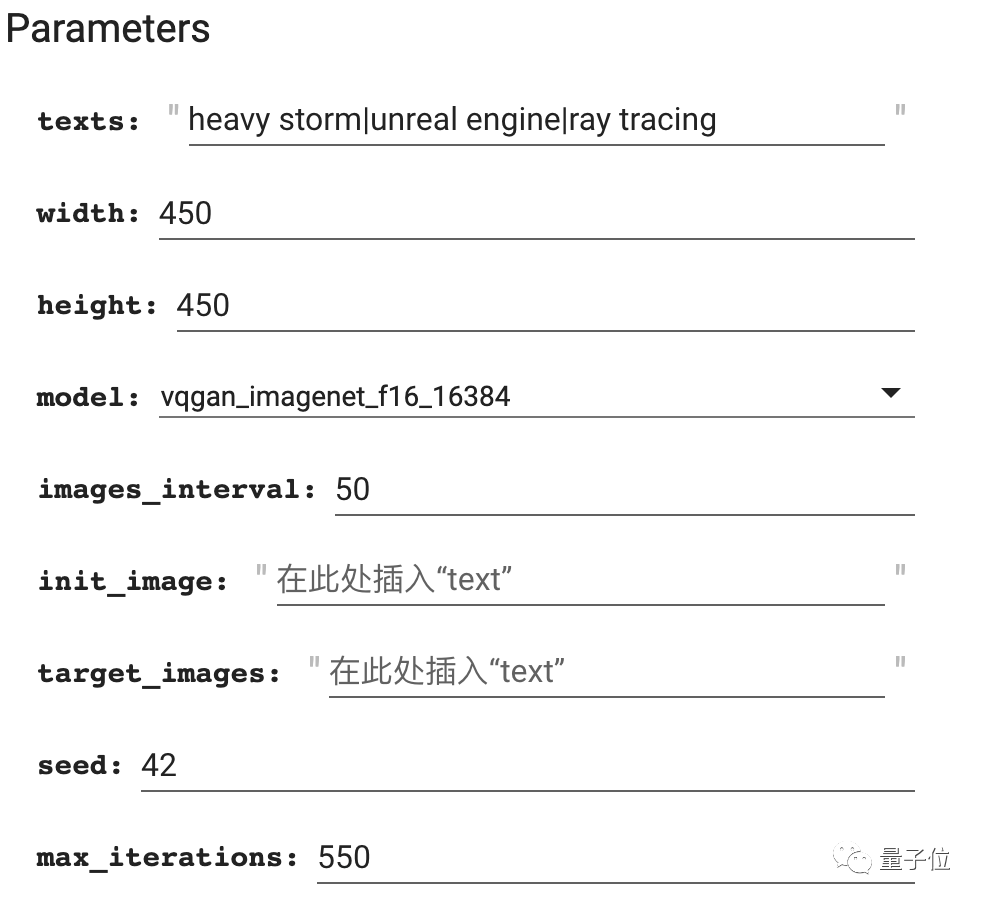

第3步,选择使用的模型,默认的是用ImageNet训练的。

第4步设置参数,一般情况下只需要在texts里填上要生成的内容,用“|”分隔。

width和height控制生成图像的分辨率,model可以选择使用的模型(需要在第3步中下载)。

改变seed的数字可以更换随机图像种子。

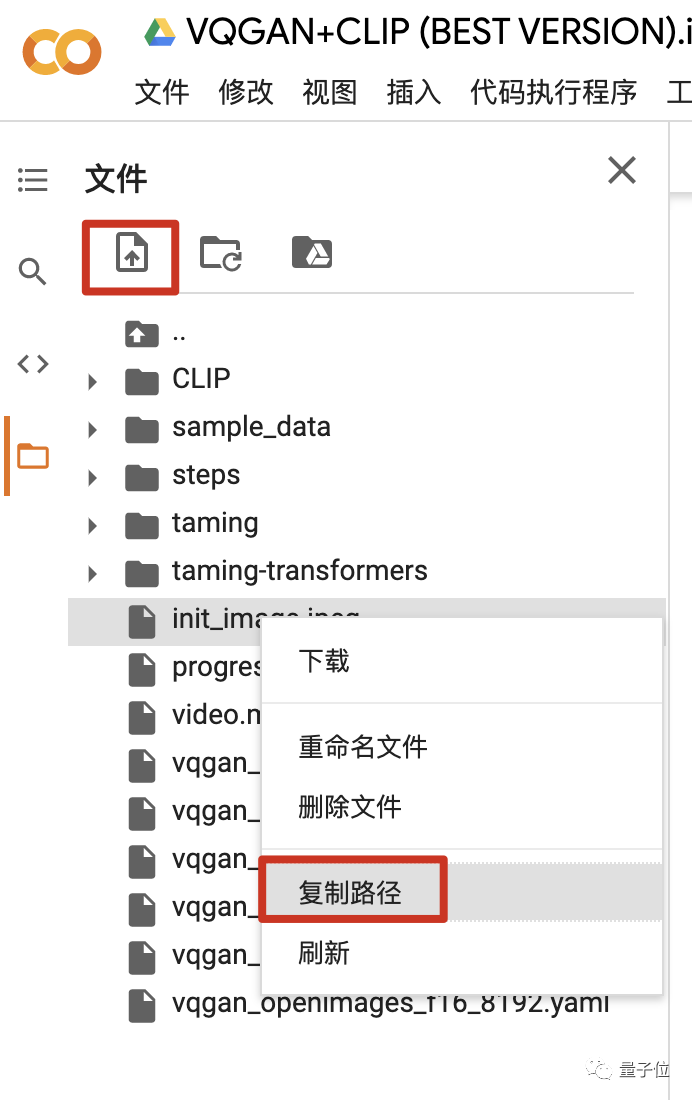

另外还可以在init_image处指定一张初始图片,需要把图片上传到Colab环境里再填入链接。

比如,有人使用这样一张图片作为图像种子,开发了新玩法:生成宝可梦。

第五步执行,300*300分辨率的图迭代500次只需要几分钟。

最后,还可以把生成的过程合成为视频。

就是这么简单,快来试试吧。

在线试玩:

https://colab.research.google.com/drive/1ZAus_gn2RhTZWzOWUpPERNC0Q8OhZRTZ

VQGAN:

https://github.com/CompVis/taming-transformers

CLIP:

https://openai.com/blog/clip/

免责声明:本文系网络转载或改编,未找到原创作者,版权归原作者所有。如涉及版权,请联系删

武汉格发信息技术有限公司,格发许可优化管理系统可以帮你评估贵公司软件许可的真实需求,再低成本合规性管理软件许可,帮助贵司提高软件投资回报率,为软件采购、使用提供科学决策依据。支持的软件有: CAD,CAE,PDM,PLM,Catia,Ugnx, AutoCAD, Pro/E, Solidworks 等。